Un Claude peut en cacher un autre

14 mai 2026Context Collective

Le mot "Claude" recouvre au moins six réalités différentes en mai 2026. Pour certains, c'est le chat sur claude.ai dans un onglet. Pour un développeur, c'est Claude Code dans le terminal qui refactore une codebase. Pour une équipe en réunion, c'est Cowork qui tient le Mac ouvert. Pour un SaaS, c'est l'API qui tourne en backend.

Même mot, six interfaces, des capacités très différentes. D'où le titre : un Claude peut en cacher un autre.

Voici la grille de lecture qui a fini par s'imposer après deux ans de pratique quotidienne. Elle a été présentée au Finist AI Club le 13 mai 2026 avec Pierre Guirriec (Polaria) pour la démo Cowork. La matière du talk est posée ici, structurée pour vivre en dehors de la salle.

D'abord, l'acteur qui tient le crayon

La cadence des sorties Anthropic produit un sentiment de complexité chez ses utilisateurs. Elle vient d'une organisation interne précise, et la regarder de près permet de démêler le reste.

Trente milliards de dollars de revenus annuels en avril 2026. Multiplié par dix en un an. OpenAI est à vingt-cinq sur la même période. Perplexity à deux cents millions. Anthropic vient donc de doubler OpenAI sur le run rate, alors que c'était l'inverse six mois plus tôt. Côté valorisation, OpenAI tient encore la pole à 852 milliards, contre 380 pour Anthropic, mais une levée en cours viserait 900 milliards. La course est serrée. Les deux entreprises brûlent 14 milliards par an chacune. Rentables pas avant 2028 pour Anthropic, 2030 pour OpenAI.

Trois autres indicateurs aident à situer le poids réel. Plus de mille grandes entreprises paient déjà Claude au quotidien (Cursor, Notion, Stripe, BCG). Une entrée en bourse en discussion pour l'automne 2026 avec Goldman, JPMorgan, Morgan Stanley. Et 3,5 GW de compute réservés pour 2027 via Google et Broadcom. Trois gigawatts et demi, c'est l'équivalent de trois réacteurs nucléaires de la centrale de Cattenom. Soit les deux tiers de Cattenom rien que pour faire tourner Claude. L'échelle est celle d'un acteur d'infrastructure industrielle.

Encore plus parlant : 100 milliards promis à AWS sur dix ans, 200 milliards à Google Cloud sur cinq ans. Trois cents milliards d'engagements cloud cumulés. Le programme Apollo (l'homme sur la Lune, 1961 à 1972) a coûté entre 180 et 260 milliards en dollars 2026. Anthropic, sur ses contrats cloud uniquement, dépasse l'effort financier total qui a mis l'homme sur la Lune.

La stratégie tient en deux phrases. Claude Code a prouvé que le modèle agentique génère un milliard de revenus en six mois. Mais le marché des développeurs plafonne à 30 millions de personnes. Cowork applique la même méthode aux cols blancs, un marché 30 à 35 fois plus grand. La promesse marketing officielle est explicite : Claude Code power for knowledge work. Tout l'arsenal entreprise sort en même temps, avec Goldman et BCG en distribution, et Microsoft qui valide la catégorie en intégrant Anthropic dans ses Copilots, après la fin de l'exclusivité OpenAI le 27 avril 2026.

La métaphore qui structure tout : le harnais

Le modèle, Claude lui-même (Opus, Sonnet, Haiku) est sans mémoire entre deux tours. À chaque appel, le contexte intégral est repassé : prompt système, historique cumulé, données récupérées, nouvelle question. Le modèle ne pilote rien, il lit et écrit du texte. C'est tout.

Ce qui transforme cette boîte muette en assistant qui agit, c'est tout ce qui se passe autour. Anthropic appelle ça officiellement "agent harness" depuis les talks de Mike Krieger. La métaphore se tient :

Le cheval tire. C'est le LLM. La force brute, le raisonnement, Claude Opus ou Sonnet. Sans lui, rien ne bouge.

Le harnais dirige. C'est l'orchestrateur. Le code autour du modèle qui décide quoi lire, quels outils appeler, dans quel ordre. C'est ce que la pratique 2026 appelle l'orchestration agentique : un LLM mis en boucle qui observe, décide, agit, recommence.

La charrette avance. C'est l'objectif. Ce qu'un humain veut accomplir.

Penser harnais, c'est penser capacités. Le code du harnais ne s'exécute pas dans le vide : il vit dans un environnement, et l'environnement décide ce qu'il peut faire. Sur un ordinateur, en application desktop ou en Claude Code, le harnais voit le filesystem, le shell, les outils du système. Dans le navigateur, il est limité par la sandbox du browser : pas de filesystem, pas de shell. Sur le téléphone, encore d'autres limites : voix, caméra, géolocalisation, mais pas l'accès aux fichiers du PC.

Cette grille rend lisibles la plupart des questions qui reviennent. Pourquoi Computer Use est dans Desktop mais pas dans Claude.ai ? Parce que le harnais d'un onglet de navigateur n'a pas les permissions système pour piloter la souris. Pourquoi Cowork ne marche pas sur mobile ? Parce qu'iOS ne donne pas à un agent l'accès aux fichiers locaux.

Six interfaces, six harnais différents

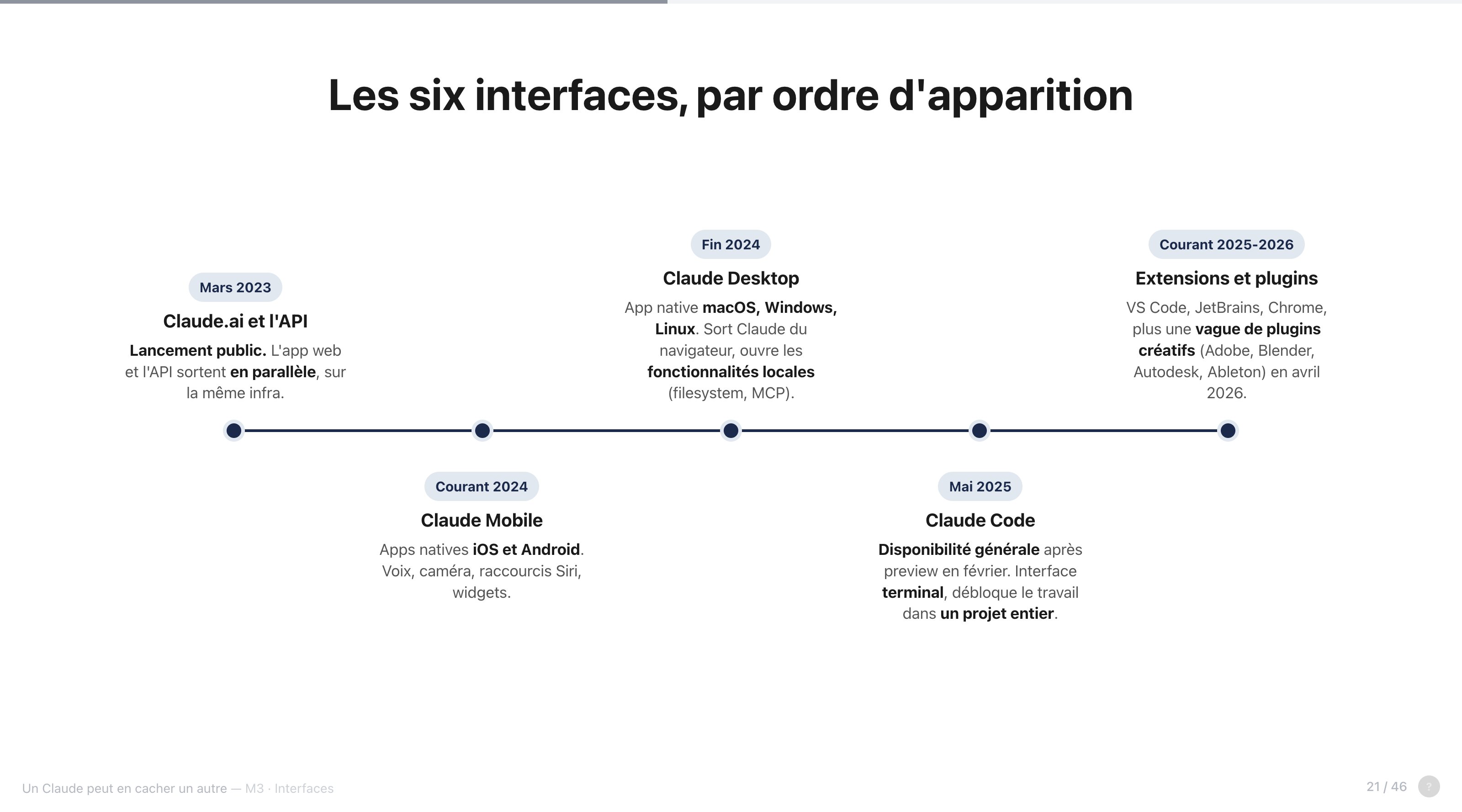

L'écosystème Claude n'est pas apparu d'un coup. Mars 2023, Claude.ai et l'API démarrent ensemble. 2024, Mobile puis Desktop sortent du navigateur. Mai 2025, Claude Code arrive dans le terminal. Fin 2025 et 2026, explosion d'extensions et accélération massive avec Cowork, Dispatch, Design.

Chaque interface lue avec la même grille : signature, contraintes, usages spécifiques.

Claude.ai, c'est un onglet, un chat, le modèle. Le harnais conversationnel pur. Tout est rendu côté serveur Anthropic. La sandbox du navigateur explique 90% des trous : Cowork, Computer Use, Plugins, Agent SDK, tout ce qui demande un environnement local n'y est pas. Reste idéal pour le brainstorm, la rédaction, l'analyse sans fichier en pièce jointe.

Claude Mobile, c'est Claude dans la poche. L'app prolonge le compte Claude en mobilité, sans capacités propres. La nouveauté 2026, c'est Dispatch, qui transforme le téléphone en télécommande du poste de travail. Une dictée "vérifie mes ventes de mai", et le Mac à la maison fait le boulot.

Claude Desktop, c'est l'application qui sort Claude du navigateur. Sorti fin 2024, c'est l'interface où vit le plus de fonctionnalités lourdes en 2026, parce que c'est elle qui débloque l'accès filesystem et les MCP locaux. macOS est en avance sur Windows pour la plupart des nouveautés. Pour les créatifs, c'est l'app qui fait la différence : MCP Adobe pour piloter Photoshop, MCP Ableton pour écrire des morceaux, MCP Blender pour la 3D.

Claude Code, c'est le harnais agent complet. Tourne dans un projet, pas dans une conversation. Tout l'arsenal agentique branché par défaut. À distinguer : Claude Code natif (le binaire CLI) et Claude Code Desktop (l'IDE), deux environnements distincts qui ne partagent pas leurs sessions. C'est l'outil le plus utilisé au quotidien chez les praticiens.

Extensions et plugins, c'est Claude greffé sur un hôte : VS Code, JetBrains, Cursor, Chrome, et la vague créative d'avril 2026 sur Adobe, Blender, Autodesk, Ableton, Splice, Affinity, SketchUp, Resolume. Très accessible en surface, bridé en profondeur par les contraintes de l'hôte. Pour l'agentique sérieuse, il faut basculer dans Desktop ou Code.

API Anthropic, c'est le sous-sol de tout l'écosystème. Toutes les autres interfaces sont des consommateurs de cette API. Tout est à construire à la main, donc puissant mais exigeant. Disponible aussi via Bedrock et Vertex pour les contraintes cloud d'entreprise.

Sur le terrain, le bon harnais pour le bon usage compte plus que le bon prompt. Prompter parfaitement dans Claude.ai pour faire ce qui se fait mieux dans Claude Code, c'est ramer pour rien.

Les questions qui reviennent en salle

Skills vs MCP. La confusion vient du fait que les deux peuvent toucher au même besoin (un skill marketing peut chevaucher un MCP HubSpot). La distinction tient en une phrase : un Skill, c'est le manuel que Claude lit. Du markdown injecté dans le contexte au bon moment. Un MCP, c'est la boîte à outils qu'il manipule. Des fonctions appelables. On peut avoir l'un, l'autre, les deux, ou rien.

Dispatch. L'intention voyage d'un harnais à un autre. Cas concret : au café, l'envie surgit de vérifier l'export du mois. Téléphone sorti, tâche dictée à Claude Mobile. À la maison, le Mac est ouvert et Cowork prend le relais. Il ouvre le fichier, lit, répond. La démo Cowork de Pierre Guirriec, en clôture du talk au Finist AI Club, a montré le pattern en usage réel : la majorité des questions du Q&A ont porté sur Dispatch, sur les coûts, sur la confidentialité, sur le mode équipe.

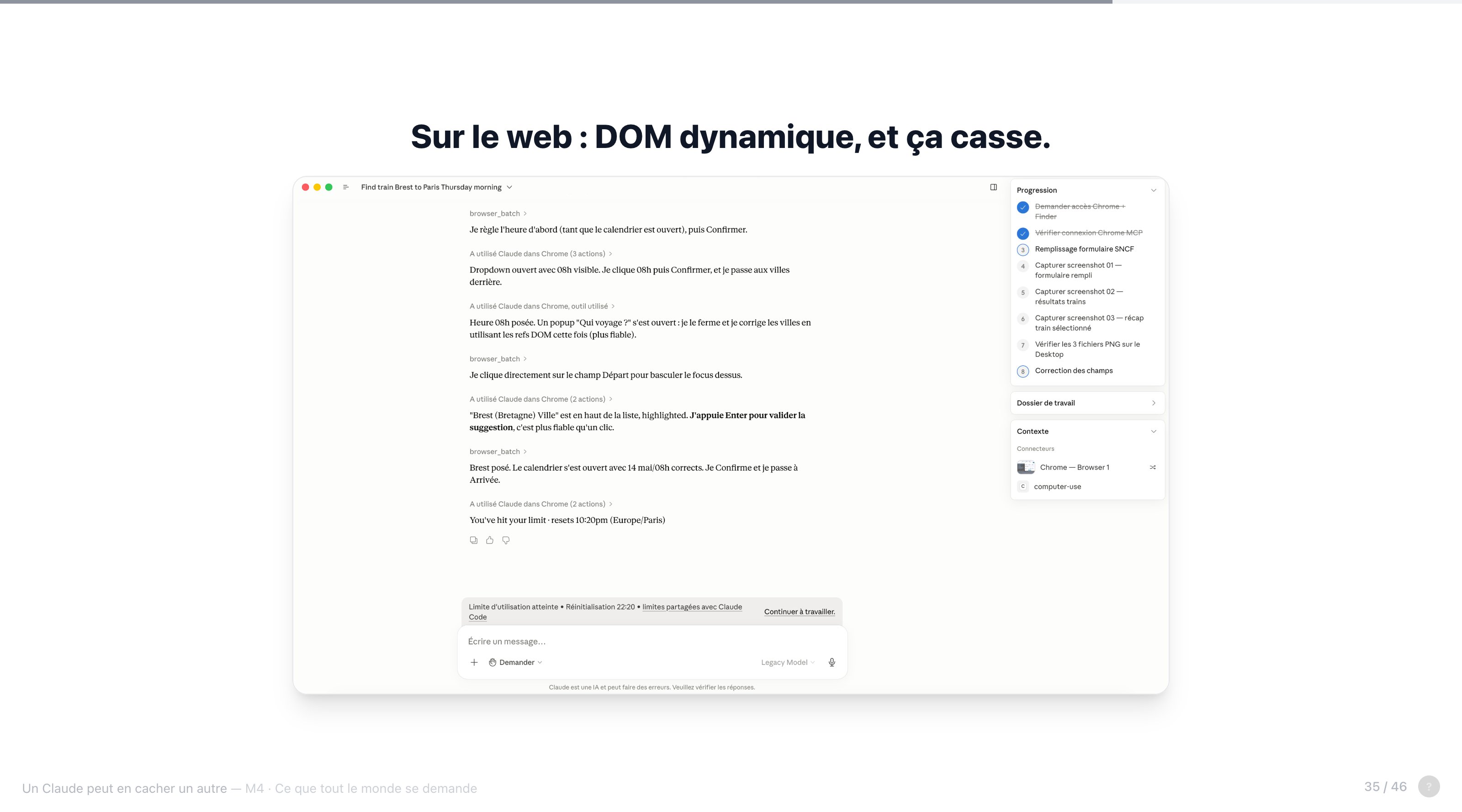

Computer Use, ça marche ou pas ? La question revient à chaque session. La promesse, vendue depuis octobre 2024 : Claude pilote l'écran comme un humain, sans API, sans scraping. La réalité, testée pour préparer le talk :

Sur app native, création d'un rappel dans Apple Reminders ("Préparer talk Anthropic, 13 mai 14h"). Ça fonctionne. Mais une seule tâche simple, et déjà passage en utilisation supplémentaire, quota reset à 22h30. Permissions système élevées à accorder à Claude : contrôle des fenêtres, accès écran, accès à l'app Rappels. Ça marche, lentement, à condition d'accepter de donner les clés de la maison à un agent.

Sur le web, tentative Brest-Paris sur SNCF Connect via l'extension Chrome. Calendriers dynamiques, popups, dropdowns qui bougent. Claude enchaîne 5-6 actions par étape, finit par envoyer un Enter au lieu d'un clic. Au milieu de la tâche, message bloquant : You've hit your limit, resets 10:20pm.

Verdict en mai 2026 : pas pour la prod. Un benchmark récent de Reflex compare Computer Use à une API structurée sur la même tâche : 551 000 tokens et 17 minutes côté CU, contre 12 000 tokens et 20 secondes côté API. Facteur 45, pas 45 pour cent, 45 fois. Sur OSWorld, Opus 4.7 plafonne à 78%. Vingt-deux étapes cassées sur cent, ce n'est pas un workflow qui marche à 78%, c'est un workflow cassé. Pour automatiser quelque chose en production, regarder côté API et MCP avant Computer Use.

Tips qu'on découvre après trois mois

Claude.ai et Mobile. Le réflexe à prendre : les Projects. Un dossier par contexte, un CLAUDE.md, les fichiers projet, et plus besoin de réécrire le prompt système à chaque conversation. Dans Cowork,

/schedule pour planifier une tâche récurrente. Piège qui coûte une matinée : Voice mode mobile est en anglais uniquement. Pour le français, c'est Dictation, qui existe nativement dans iOS et macOS.Claude Code, les raccourcis. Shift+Tab toggle Normal → Auto-Accept → Plan, le raccourci le plus utile à connaître. Ctrl+G ouvre vim ou nano pour rédiger un long prompt sans taper dans le terminal. Ctrl+B met une tâche en background pour en démarrer une autre. Ctrl+R retrouve une vieille commande, Ctrl+T voit ce que Claude fait sans interrompre. Le piège Mac qui met trois semaines à apparaître : pour coller une image, c'est Ctrl+V, pas Cmd+V, parce que le terminal intercepte Cmd+V avant Claude Code.

Claude Code, les workflows.

@fichier pour référencer du code sans copier-coller. ! pour injecter du contexte shell. /loop pour les tâches récurrentes jusqu'à 7 jours. --worktree pour paralléliser plusieurs sessions sur le même repo sans qu'elles s'écrasent. Les hooks dans .claude/settings.json : Stop pour lancer les tests quand Claude termine et le ramener si c'est rouge, PreToolUse pour bloquer les commandes dangereuses, PostToolUse pour formatter après chaque edit, SessionStart pour injecter le contexte au démarrage. Tout vit dans un seul fichier, configuré une fois pour toutes.Claude Desktop. Sa force, ce sont les MCP. Le MCP Filesystem, le plus simple et le plus puissant : Claude voit les fichiers locaux, les lit, les modifie. Fini le copier-coller dans le chat. Les MCP créatifs (Adobe, Blender, Ableton) ouvrent Photoshop ou écrivent des morceaux. Ce n'est pas un harnais agent complet (pour ça c'est Claude Code), mais pour intégrer Claude dans une stack créative, Desktop reste imbattable.

Le pack étendable. Pas besoin de tout réinventer. Anthropic publie des Skills officiels sur GitHub : pptx, xlsx, docx, pdf, et même claude-api pour bosser sur du code Anthropic SDK. Le MCP marketplace, c'est claude.com/marketplace, 200 connecteurs vers Notion, Linear, GitHub, Postgres. Les Plugins Claude Code, c'est un bundle : une installation, et Skills, MCP, slash commands et hooks arrivent groupés.

Ce qui est encore bancal

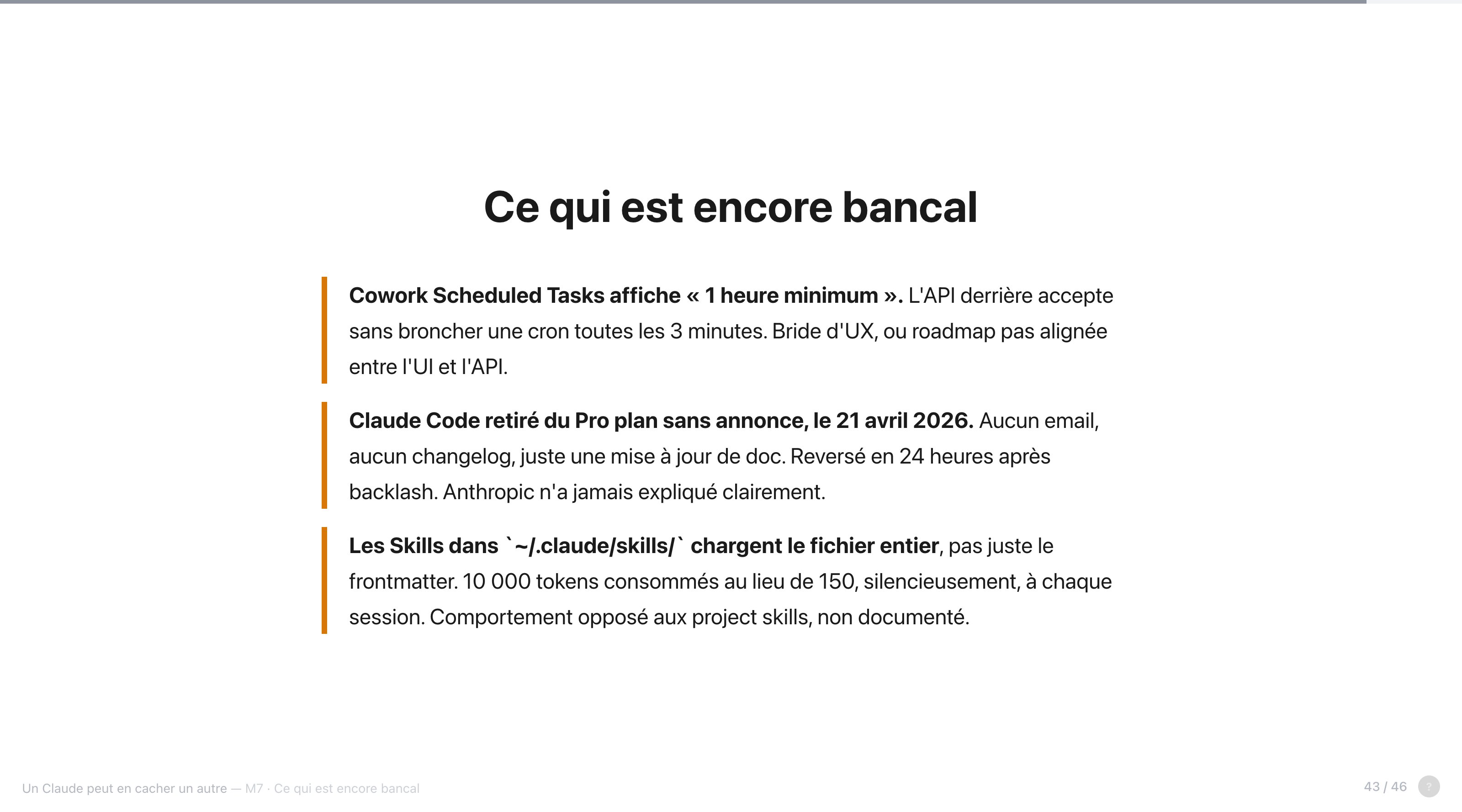

Cowork Scheduled Tasks. La doc et l'UI affichent "1 heure minimum". L'API derrière accepte sans broncher une cron toutes les 3 minutes. Bride d'UX, ou roadmap pas alignée entre l'UI et l'API. Le garde-fou est juste cosmétique.

Claude Code retiré du Pro plan, sans annonce, le 21 avril 2026. Aucun email, aucun changelog, juste une mise à jour de doc. Reversé en 24 heures après le backlash. Anthropic n'a jamais expliqué clairement. Ce genre de signal rend prudent sur la stabilité des engagements tarifaires.

Les Skills dans

~/.claude/skills/ chargent le fichier entier. Pas juste le frontmatter. 10 000 tokens consommés au lieu de 150, silencieusement, à chaque session. Comportement opposé aux project skills, non documenté. Du gaspillage de contexte invisible tant qu'on ne sort pas la calculette.

Pour finir

Il n'y a qu'un seul modèle, Claude. Mais il vit dans plein de harnais différents. Claude.ai, Mobile, Desktop, Code, l'API, les extensions. Le bon harnais pour le bon usage compte beaucoup plus que le bon prompt.

L'écosystème bouge vite, mais le socle est stable. Les noms qui circulent aujourd'hui ne seront pas tous là dans six mois. La métaphore du harnais, oui. La grille reste lisible quoi qu'il sorte.

Anthropic est devenu un acteur d'infrastructure. 30 milliards de revenus, des engagements cloud supérieurs à Apollo, l'usine Labs qui sort un produit après l'autre. L'entreprise s'est transformée en plateforme qui se déploie en couches, après avoir longtemps été un labo qui livrait un modèle.

Questions du public

Le talk a été interrompu par une coupure de quota Claude avant la session Q&A. Les questions reçues via le QR code sont reprises ici, avec réponses courtes.

Hello, c'est quoi un Skill Claude Code ?

Un fichier markdown placé dans

~/.claude/skills/ ou .claude/skills/ (project) avec un frontmatter (description) et des instructions. Claude lit seulement la description, et charge le SKILL.md complet quand la demande de l'utilisateur correspond. Pratique pour packager une procédure réutilisable (générer un PDF, structurer un mail type, etc.).Quand est-ce que Claude Mythos sortira pour le grand public ?

Jamais, en l'état des annonces. Mythos est un modèle frontier d'Anthropic spécialisé en cybersécurité offensive, réservé au Project Glasswing (consortium AWS, Apple, Google, Microsoft, NVIDIA, etc.) et aux opérateurs d'infrastructures critiques. Accès uniquement via API à $25 / $125 par million de tokens.

Les slides de la présentation sont-elles disponibles en ligne ?

Oui. Le PDF est en bas de cet article, et le replay interactif est sur slides.academy.koality.fr.

Pourquoi Claude s'appelle Claude ?

En hommage à Claude Shannon (1916-2001), mathématicien fondateur de la théorie de l'information, dont les travaux sont au fondement mathématique des LLM. Le choix a été fait par les cofondateurs Dario et Daniela Amodei.

C'est quoi le bail avec le Pentagone ?

Anthropic a signé en novembre 2024 un partenariat avec Palantir et AWS pour fournir Claude à la défense américaine via la plateforme Lattice. Lancement de Claude Gov en juin 2025, version dédiée aux agences fédérales avec hébergement classifié. La Usage Policy d'Anthropic interdit explicitement les opérations offensives et le ciblage civil.

Comment debuguer un MCP ?

Trois réflexes. D'abord les logs côté Claude (Settings > Developer > MCP Logs sur Desktop, stderr en CLI). Ensuite tester le serveur en isolation avec

npx @modelcontextprotocol/inspector pour vérifier qu'il répond bien aux appels JSON-RPC. Si l'outil n'apparaît pas dans Claude, vérifier le schema JSON (les erreurs de schéma sont silencieuses).Quelle est la roadmap Anthropic ?

Pas de roadmap formelle publique. Les annonces produit sortent à Code with Claude (conférence annuelle, dernière édition le 6 mai 2026) et en billets blog. Axes connus pour 2026 : durcissement Cowork pour l'entreprise (SCIM, audit, plafonds), Claude Design (avril), accélération de l'agentique. Les modèles suivants après Opus 4.7 et Sonnet 4.6 n'ont pas de date publique.

Cybersécurité Claude Desktop : accès aux ressources locales, fuites de données ?

Question légitime. Claude Desktop accède au filesystem local via MCP, surface d'attaque réelle. Bonnes pratiques : limiter les MCP installés au strict nécessaire, vérifier la source avant install (privilégier les officiels Anthropic), désactiver MCP filesystem sur les dossiers sensibles, ne pas activer Auto-Approve sur tous les outils. Prompt injection confirmée par Johann Rehberger en octobre 2025, avec démonstration d'exfiltration de 30 Mo.

Pratiques pour poursuivre un sujet dans une nouvelle discussion sans saturer le contexte ?

Trois leviers. Premier : recommencer une nouvelle conversation pour un nouveau sous-sujet plutôt que d'empiler. Deuxième : dans Claude Code,

/compact résume l'historique et garde le contexte critique. Troisième : capturer l'état dans un fichier (NOTES.md, CLAUDE.md, ou un Project sur Claude.ai) plutôt que dans l'historique qui se perd.Les SI acceptent-ils l'installation de Cowork ? Et Claude Code ?

Variable selon l'organisation. Depuis mai 2026, Cowork dispose des contrôles d'entreprise (SCIM via Active Directory, logs vers Splunk, plafonds de dépenses, groupes de permission) qui débloquent les DSI. Claude Code reste plus difficile à industrialiser parce qu'il tourne en local sur le poste développeur, hors du périmètre IT classique. La plupart des grandes boîtes acceptent une phase pilote avant un déploiement large.

Y a-t-il des mécanismes pour partager du contexte entre projets (back + front) et entre rôles (devs, business analyst, PO) ?

Trois pistes. Pour partager entre repos, un dossier parent avec CLAUDE.md à la racine, plus des CLAUDE.md locaux chargés en cascade. Pour partager entre rôles, les Plugins Claude Code permettent de bundler skills et MCP par profil (dev, analyst, PO). Pour du contexte vraiment dynamique, un MCP custom qui lit depuis une base partagée (Notion, Linear, base SQL) est la voie la plus solide.

Y a-t-il un équivalent au Dispatch d'Anthropic chez GitHub Copilot ?

Pas d'équivalent direct en mai 2026. La fonctionnalité la plus proche est GitHub Copilot Workspaces (2024) qui permet de lancer des tâches depuis le web GitHub, sans pont vers un agent qui tourne sur le poste local. Cursor a un mode background mais pas multi-device. Dispatch reste spécifique à l'écosystème Anthropic pour l'instant.

Comment sont gérés les risques de cybersécurité pour Dispatch, avec l'auto-approve qui se généralise ?

Risque réel et reconnu. Auto-approve étend la surface d'attaque parce qu'une instruction malicieuse (prompt injection via un fichier piégé, une page web, un email lu par Claude) peut déclencher des actions sans confirmation utilisateur, avec un risque de RCE côté Anthropic en cas d'exploitation amont. Pratique recommandée : Auto-approve seulement sur les sessions où le contenu d'entrée est contrôlé, jamais sur des projets qui ingèrent du contenu tiers (mails, sites web, fichiers externes). Anthropic publie un Trust Center et un programme de bug bounty pour ces classes de failles.

Slides de la présentation

Slides : Un Claude peut en cacher un autre

Télécharger*Ce billet est tiré du talk donné le 13 mai 2026 au Finist AI Club, à l'Atelier des Capucins de Brest, avec Pierre Guirriec (Polaria) pour la démo Cowork. *